(來源:WAM)

就算要發展一部跟人類有同樣智能的通用型人工智能,至今仍面臨技術瓶頸,卻不代表目前的人工智能技術沒有進展,霍金的憂慮或許在未來有實現的可能,但以現階段的弱AI人工智能技術而言,我們無須憂心忡忡地認為人類已被人工智能取代。唯有認識到這一點,我們才會在思索人工智能對社會及個人未來生涯的衝擊時作出較為準確的判斷,這樣才能提出適當的應對之道。

【文/吳振南】

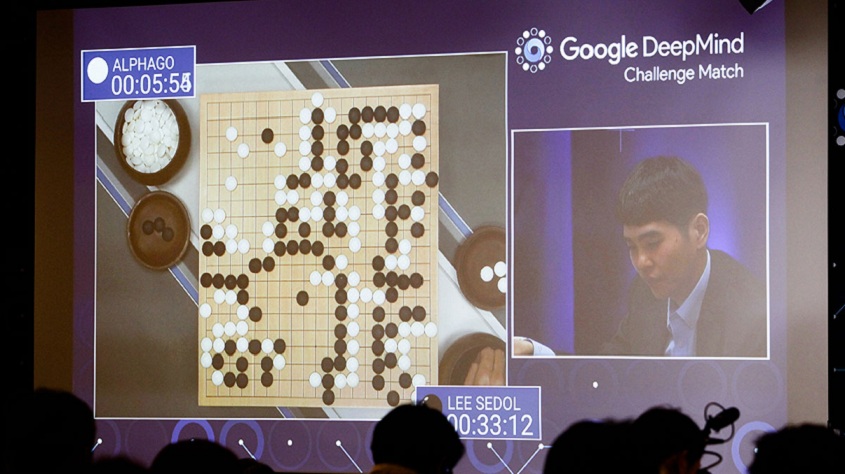

猶記在四年前,當Google的下圍棋機器人Alphago贏了圍棋世界冠軍後,我曾經撰文〈AI人工智能發展的人文反思〉呼籲馬來西亞公共知識圈,應圍繞著人工智能來思索其可能衝擊的相關議題,擬訂對策並對人工智能作必要的人文反思。

令人欣慰的是,如今年輕人圈中對人工智能的討論日漸增多,對當代機器人可能對未來工作職缺造成的衝擊也了然於胸。讓我訝異的是,如今在更為基本的人工智能定義問題上,觀點較顯得混淆,舉例來說,有人說到某些科學家逸事趣聞時,會憂慮的說,曾寫出超有趣物理科普書《時間簡史》(A Brief History of Time)的英國天文物理學家霍金(Stephen Hawking)逝世前,好幾次警告若全力發展AI,人類恐將自取滅亡。因為對霍金來說,當AI發展到比人類還優秀時,將變成一種超越人類的「新型態的生命」。

有時我聽到年輕朋友用嘲諷的語氣,笑說電動車領導品牌特斯拉(Tesla)的老闆馬斯克(Elon Musk,下圖)是個自相矛盾的科技人,一方面警告隨著人工智能崛起,人類有可能會成為AI機器人的「家貓」寵物;可是其公司卻宣布將在2022年推出具AI的人形「特斯拉機器人」原型機,來執那些危險或過於重複,甚至程序太無聊、不容易找到工人的工作。

(來源:Teslarati/Nowtheendbegins.com)

(來源:Teslarati/Nowtheendbegins.com)

擁抱抑或抗拒人工智能?

因此我也常常聽到年輕人依樣畫葫蘆地說,不要太過信任人工智能,甚至倡議不應發展人工智能!問題是,馬斯克真的是一個矛盾的人嗎?霍金所謂的人工智能真的是指目前職業圍棋界打遍天下無敵手的Alphago嗎?要回答上述問題並不困難,甚至可以說,只要對目前AI產業發展有點了解,很容易就可以解釋上述的矛盾現象。

讀者若翻閱我的拙作,就可發現文中強調有關人工智能最常見的區分方式,便是強AI與弱AI。

無論馬斯克或霍金在警惕應該時,其實指的都是強AI;而不論Alphago或「特斯拉機器人」,這些AI應用的開發,都源於弱AI的路徑。你一定很好奇,人工智能就是人工智能嘛,為何還有強弱之分?這跟人工智能的哲學爭辯有關。根據人工智能最簡單的定義如下:如果有一部機器,它的行為與人類具有同樣的智能,這種經由機器表現的智能,就叫做人工智能。

你一定會說,這不是白說嗎?就是人造的智能啊!話是這樣講沒錯,但定義雖然不難,要做到檢測什麼是符合標準的人工智能並不容易,這不像檢測一雙鞋的品質如何,只要找人穿著走路,你就會知道它有多好穿,有多耐穿。

人類對造人的想法源遠流長,但大多只能存在於神話裡如女媧造人,或不成形的科技幻想如煉金術,甚至是科幻小說如雪萊(Mary Shelley)的《科學怪人》(Frankenstein),究其原因是科學發展一直未能提出檢測人工智能的標準!

一直到1950年,英國數學家圖靈(Alan Turing)才終於提出一個簡單又容易操作的人工智能檢測方式—圖靈測試(Turing test,下圖)。他認為,要判定一部機器是否擁有人工智能時,可做以下實驗:在三個各自獨立的房間,同時坐著兩個人與一部機器,其中一人透過電腦螢幕同時與另一人和機器聊天,若他不能分辨出跟他聊天兩個物件中,哪個是機器、哪個是人,那麼這部聊天機器就可視為是具人工智能。

圖靈測試的應用與啟發

這個檢測在當代人看來並不難想像,也不陌生對吧。只要把裡頭設想的機器,換成在Iphone的Siri或Google的Meena,我們可是經常跟這類軟體在聊天的!不過若仔細分析圖靈測試,便會發現這個思想實驗若真要達到判定人工智能的效果,那它就是在說,「語言」或「透過語言溝通、說話」才是判定人類具有智能的標準。換言之,上述有關人工智能的簡單定義應該改寫如下:當我們說一部機器具有人工智能時,意思是它具有使用語言跟人類溝通、說話的能力。

人工智能的這個定義比起原來的簡單定義要具體的多,但有一個麻煩,就是它涉及人類如何使用語言的問題。從德國哲學家弗列格(Gottlob Frege)研究語言哲學的專名問題(theory of names)開始,我們便發現人類語言的功能(特別是專名)具有兩個面向:意義(meaning)和指涉(reference)。

例如這個句子:「晨星就是金星。」可寫成這樣的名稱等式「晨星=金星」。所以我們是否可以推論說,「晨星」這個名字的意義就是「金星」這個名字的意義呢?顯然不行。

我們可以說,在這個等式的兩邊,同樣可用來指涉一個語言符號以外的同一個物體—位於太陽系的行星「金星」,但在語意解釋上,「晨星」的意義顯然跟「金星」的意義有所不同。例如「晨星」的意思是早上升起的那顆星星,而「金星」的意義則是太陽系裡的那顆行星。

一旦考慮到語言的這兩個面向,就會發現圖靈測試必然會遭遇的窘境:機器所使用的溝通語言,其實都是經由工程師編碼而成的內容,所謂人工智能,其實是反映工程師腦裡語意的編碼,而這個編碼不一定能反映外部真實的世界,也不能代表人類語言使用者的真正語意。換言之,當機器的語言既不具有跟人類語言一樣的指涉功能,而且還無法判斷句子的真假,我們很難將說這種語言的機器,視為跟人一樣有智能。

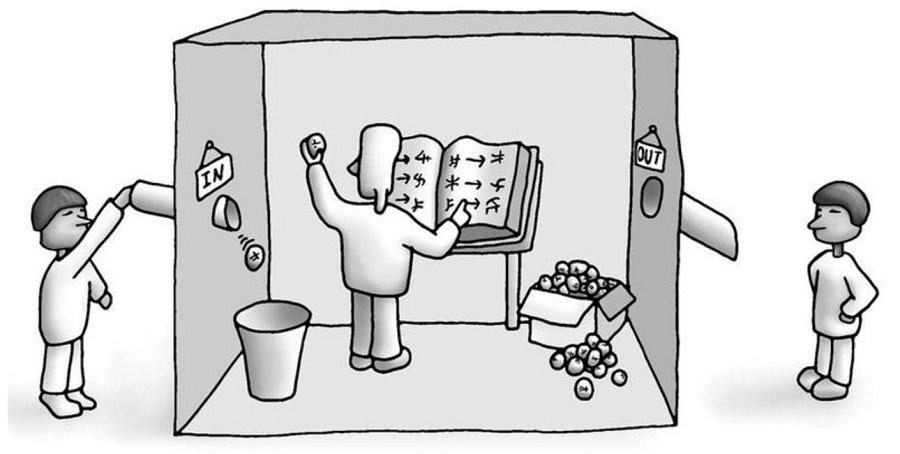

以此為論據,主張機器不具有人類智能的,又以美國哲學家希爾勒(John R. Searle)提出的「中文房間實驗」(Chinese room experiment,下圖)最具代表性。

(來源:Medium/Wikicomms)

(來源:Medium/Wikicomms)

利用思想實驗汲取直覺

簡單來說,就是有一個完全不會中文的人,在一間有一本用英文寫成的中文應對手冊房間裡,利用手冊回答外界的中文提問,可是他卻完全不懂提問的真正意思,房裡的人就相當於目前現有的電腦,房外的人是使用者,手冊就是電腦程式。也就是說,只要電腦工程師編寫出適當的編碼,可以讓我們會誤以為人工智能真的有人類的智能,但實際上AI的知識根本僅是編碼而已。

就如科幻小說中常見的橋段,很能說明機器語言的限制;話說有一個AI機器人,能讓每個和它聊天的人感到心情愉快,尤其它有關美麗火山湖的描述可說是世上講到這個火山湖時最好的詩篇。有位從小住在火山湖附近的老人最喜歡跟它聊天,因為只有在跟它聊天時,老先生才感到這座湖還在,可事實是,這湖的美景早在幾十年前,隨火山爆發而毀於一旦。

這就表示說,對AI機器人來說,機器理解的語言,僅僅是一種符號應對的技能,它使用的語言,是不能連接到外部世界的。(對,我相信已有人想到電影《駭客任務》Matrix的情節)。當然圖靈的支持者會說,這時只要工程師重新編寫、修正這個程式就好了,更激進的還可能會說,其實AI機器人跟外部世界的連結,正是由這些工程師提供的。

問題是,人在說一句話時,是可以透過直接觀察世界,去判斷句子的真假,並隨時修正自己的說法,機器卻很難及時做到這點,就這一點來說,通過圖靈測試的機器是否擁有人工智能,就不言而喻了!

更別說這個判斷句子真假的能力,有時候是生死攸關的,以特斯拉自駕車來說,就曾發生AI自駕系統將停在前方的大型羅里誤認為是霧而車禍撞死車主。原因就是在編碼的機器語言中,將在前方停止不動但離開地面有段距離的事物判定為霧,車子可以繼續前行,只是不幸的是,大型羅里的貨櫃也離開地面有段距離,當羅里停駛時,在機器語言裡,就變成跟霧沒有兩樣了。

這也是當代通用型人工智能發展亟需解決的問題,強AI支持者稱之為資格問題(qualification problem),當我們要造一個跟人有一樣智力的機器出來時,往往會發現,許多人類做起來很簡單的事情,在進行編碼時,卻有可能無法把所有條件列出,所以機器往往會無法做這類事情。例如要用編碼方式,讓機器人通過一間有許多障礙的房間是極其困難的,但對一位人類的小孩來說,做這樣的事就像在玩遊戲一樣。

人工智能深度學習框架

不過,就算要發展一部跟人類有同樣智能的通用型人工智能,至今仍面臨技術瓶頸,卻不代表目前的人工智能技術沒有進展,使用神經網絡訓練方法讓機器來進行學習的深度學習(Deep learning)框架,可說是弱AI裡發展得最好一項技術,Alphago就是利用這個學習框架,變成世界圍棋第一把手。

弱AI又可稱為特定AI,是指在特定領域裡來訓練機器,如下圍棋、人臉辨識、幫忙打掃住家,或產品組裝,寫即時新聞等,目前在前述的特定領域,AI已經比人做得更好更有效率了。

值得注意的是,強AI初期多由電腦專家開發,大多是運用邏輯運算方式編寫AI,所以演算的語意或說真假值便很重要。以圖靈機為例,從一個狀態到下一狀態,要不走1的路徑或走0的路徑,如投幣式販賣機就是如此,丟一塊錢進去,所有符合1的按鈕都會亮起,是0的就不亮。

但幾乎所以弱AI的開發,都是用機率的想法來量化某些不確定命題,如下一狀態是1的機率較大,還是0的機率較大呢?我們有多確定這個事件會發生?當這樣考慮時,「確定」的程度,是可以用 0 到 1 之間的數值來表示。這種讓AI本身從大量的資料中找出規律來「學習」的人工智能開發方法,便是當代「機器學習」的主流做法。

這個做法的好處是,隨著機器人處理的相關統計資料,以及使用者的回饋越來越多,它對事情的判斷方式,就會越來越接近人類「合理」的回應。大家是不是跟我一樣,也發現siri或Meena,會根據你個人的說話習慣,來分辨你的語音和喜好的聊天方式呢?是否注意到用Google翻譯時,出來的文句通順程度,比起這個服務初出爐時好了很多?

當然,這篇文章並不會下結論說,強AI永遠不會被製造出來。霍金的憂慮或許在未來有實現的可能,但以現階段的弱AI人工智能技術而言,我們無須憂心忡忡地認為人類已被人工智能取代了!

我相信,唯有認識到這一點,我們才會在思索人工智能對社會及個人未來生涯的衝擊時作出較為準確的判斷,這樣才能提出適當的應對之道。

吳振南 吳振南 |

旅居臺灣的馬來西亞人,前報業從業員,目前是專職相妻教子的家庭煮夫與兼職文化玩童。 |

本文內容係作者個人觀點,不代表當代評論立場。

喜歡這篇文章請加入當代評論臉書專頁,給予我們支持與鼓勵!

(來源:

(來源: (來源:

(來源: